2019 habe ich in einem Artikel die Frage gestellt, was uns (als Menschheit) wohl als Erstes umbringen wird. Eine Option, die ich damals nach Klimawandel, Umweltzerstörung und sozialer Kälte anführte, war auch die künstliche Intelligenz (KI). Und leider habe ich in den letzten Wochen und Monaten einiges gelesen, was zeigt, dass diese wenig optimistische Einschätzung wohl nicht ganz verkehrt gewesen ist.

Das fängt schon damit an, dass mittlerweile jeder Hans und Franz mithilfe von KI Bilder und Videos herstellen kann, die kaum noch von der Realität zu unterscheiden sind. Klingt erst mal vielleicht trivial, hat aber erhebliche Auswirkungen darauf, wie wir die Welt wahrnehmen über Medien – und das ist ja nun mal der allergrößte Teil der Welt, zumindest deutlich mehr als das, was wir ganz direkt in unserer Umgebung sehen und hören.

Besonders prominent ging da vor ein paar Wochen der Fall von Collien Fernandez durch die Medien, deren Ex-Partner Christian Ulmen mithilfe von KI pornografische Darstellungen von ihr erstellt und dann in sozialen Medien verbreitet hat. Dass das nicht nur einfach eine kleine persönliche Schäbigkeit ist, wird dadurch deutlich, dass Fernandez das Ganze als virtuelle Vergewaltigung wahrgenommen hat und der Fall nun vor Gericht gelandet ist.

Und mittlerweile geht das mit den KI-erzeugten Inhalten weit über solche Mobbing-Vorfälle hinaus, denn es tauchen immer öfter KI-Bilder und -Videos in klassischen Medien auf, ohne als solche gekennzeichnet zu werden – was eigentlich verpflichtend ist. Aber selbst professionelle Journalisten von Leitmedien sind offenbar nicht davor gefeit, KI-Darstellungen auf den Leim zu gehen.

So wurde im heute journal (ZDF) im Februar ein KI-Video in einem Beitrag über Einsätze der US-Gestapo ICE eingebaut, ohne das explizit zu erwähnen oder zu kennzeichnen. Die Reaktion des Senders (s. hier) war daraufhin auch alles andere als glücklich oder transparent, sodass schnell Gerüchte über Fake News die Runde machten, die dann den gesamten Inhalt des Beitrags diskreditierten.

Im März hat es dann die Redaktion vom Spiegel erwischt, als dort nämlich mit KI manipulierte Bilder ohne entsprechenden Vermerk auftauchten in der Berichterstattung zum Angriffskrieg von USA und Israel gegen den Iran. Dort war man dann allerdings bemüht, den Vorfall in der Öffentlichkeit transparent nachvollziehbar zu machen, und aus dieser Erklärung wird dann auch deutlich, wie komplex diese Thematik ist, denn eigentlich kamen die manipulierten Fotos von einer vertrauenswürdigen Quelle.

Zudem geraten ja nicht nur versehentlich KI-manipulierte oder -generierte Inhalte in Beiträge, sondern KI wird auch ganz gezielt eingesetzt, wie im Newsletter von Über Medien vom 13. 2. 2026 geschildert wird:

Es ist so weit: Die ARD zeigt jetzt KI-generierte Videos in ihren Nachrichtenbeiträgen. In einem Bericht zum 100-jährigen Geburtstag der Spraydose erweckt „NDR Info“ kurzerhand das Foto eines norwegischen Ingenieurs zum Leben, der seine Skier nicht mehr mühsam von Hand wachsen will. Man sieht ihn, wie er seine Skier wachst, Ski fährt und eine Spraydose hält. Die Szenen sind als KI-Material gekennzeichnet – allerdings ist der Hinweis so ungünstig über dem NDR-Logo platziert, dass von dem Wort „KI-generiert“ nur das „generiert“ gut zu lesen ist.

Jetzt könnte man sagen: Naja, von historischen Begebenheiten gibt’s halt einfach keine Bilder. Durch Künstliche Intelligenz kann die Geschichte aber trotzdem gezeigt und erlebbar gemacht werden. Das stimmt. Aus einem ähnlichen Grund greifen Fernsehbeiträge auch manchmal auf Szenen zurück, die von Schauspielern nachgestellt wurden.

Bei „NDR Info“ hat man sich die Menschen dieses Mal gespart und stattdessen die KI-Kiste angeworfen. Das führt allerdings dazu, dass die meisten Schriftzeichen auf der KI-generierten Spraydose relativ wenig mit echten Buchstaben zu tun haben und der Forscher beim Skifahren bemerkenswert flott eine Piste entlangwedelt, die gar nicht steil genug dafür aussieht. Das sind Kleinigkeiten, klar. Aber die Szenen suggerieren ein wahres Bild einer historisch echten Begebenheit – nur sind sie eben nicht echt.

Ehrlich gesagt bin ich mir noch nicht sicher, was ich davon halten soll. Ich glaube schon, dass die Zuschauer schlau genug sind, die echte Geschichte von den unechten KI-Bildern zu unterscheiden – zumal das ja auch (einigermaßen) transparent gekennzeichnet ist. Problematisch wird es aber, wenn nicht nur unwichtige Kleinigkeiten falsch generiert werden, sondern wichtige Details.

Daran sieht man, dass die Grenze hier fließend ist. Was ist im Grunde noch in Ordnung, wenn es durch KI dargestellt wird, was nicht? Wie genau muss man das dann kenntlich machen? Das schreit doch irgendwie schon danach, dass immer wieder mal KI-Inhalte den Zuschauern untergejubelt werden, ohne dass man diese gleich als solche erkennen kann.

Der Medienwissenschaftler Stephan Weichert schildert in einem Artikel auf Über Medien, wie KI die Arbeit von Journalisten verändert und welche psychologischen Effekte sich aus der redaktionellen KI-Nutzung ergeben. Er bilanziert:

KI kann Redaktionen womöglich effizienter machen, vielleicht auch informierter – vor allem aber macht sie bequem. Und Bequemlichkeit ist das eigentliche Gift für den Journalismus. Nicht, weil sie uns alle „faul“ macht, sondern weil sie über kurz oder lang Zweifel, Reibung und Widerspruch aus dem Arbeitsalltag herausfiltert.

Und das könnte dann wiederum bewirken, dass inkorrekte Inhalte verbreitet werden, weil sie eben nicht hinreichend recherchiert wurden. „Die KI hat aber gesagt …“ dürfte dafür dann eine immer häufiger vorkommende Rechtfertigung sein.

In einer globalisierten Welt ist es fatal, wenn wir Informationen nicht mehr trauen können, denn schließlich ist es uns unmöglich, alles, was uns betrifft, höchstpersönlich in Augenschein zu nehmen. Und wenn mittlerweile selbst die Polizei bei ihren Social-Media-Beiträgen schon KI-Bilder nutzt, um Stimmung zu machen und ohne diese deutlich genug zu kennzeichnen (s. hier), dann trägt das sicher nicht dazu bei, das Vertrauen der Menschen in Berichterstattung jedweder Couleur zu stärken.

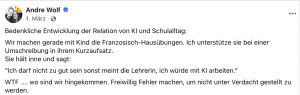

Doch auch im ganz normalen Alltag schürt KI das Misstrauen (von dem wir nun wahrlich schon seit Jahren genug haben, wie ich bereits 2015 in einem Artikel feststellte), wie ein Posting von Andre Wolf von Mimikama auf seiner Facebook-Wall zeigt:

Misstrauen ist dann auch zunehmend ein Thema bei der Musik, denn immer mehr KI-generierte Songs fluten das Web, und es gibt viele Hörer, die das nicht so richtig toll finden. Solche KI-Songs kann man mittlerweile relativ einfach mit ein paar lockeren Vorgaben herstellen. Das Resultat ist dann zwar in der Regel nicht sonderlich spannend, sondern besteht aus reichlich stereotypen Bestandteilen, allerdings gibt es ja auch viel Musik, die von richtigen Menschen gemacht wird und auf die das so zutrifft. Und so fällt es immer mehr Hörern schwer, überhaupt festzustellen, ob der Song, den sie gerade online hören, von einer realen Person komponiert und eingespielt wurde oder einfach nur von KI.

Das ist mittlerweile auch kein randständiges Phänomen mehr, sondern macht bereits geschätzte 40 Prozent der online hochgeladenen Musik aus. Mal werden Songs einfach plump geklaut und nur gering verändert, was dann dazu führte, dass die GEMA mittlerweile eine Klage angestrebt hat gegen das Unternehmen der Musik-KI Suno, weil hier eindeutig Urheberrechte verletzt werden. In einem Artikel von Business Punk dazu heißt es:

Wenn 40 Prozent aller Musik-Uploads bereits von Algorithmen stammen, ist das keine Innovation mehr. Das ist Verdrängung. Suno und Co. haben sich an Millionen geschützter Werke bedient, ohne zu fragen. Jetzt behaupten sie, die KI habe nur „gelernt“. Wenn die KI auf Knopfdruck „Atemlos“ nachbaut, ist das keine abstrakte Mustererkennung – das ist eine hochkomprimierte Kopie.

Die GEMA fordert 30 Prozent der Einnahmen. Das klingt nach viel, ist aber der einzige Weg, um Künstler vor der KI-Walze zu schützen. Wer jetzt auf technische Filter hofft, ist naiv: KI-Anbieter werden ihre Modelle so optimieren, dass sie keine direkten Kopien mehr ausspucken – aber trotzdem mit menschengemachter Musik trainiert wurden. Das Ergebnis: Urheber gehen leer aus, KI-Konzerne kassieren. Die Frage ist nicht, ob KI Musik machen darf. Die Frage ist, wer dafür bezahlt. Und die Antwort muss lauten: die KI-Anbieter.

Denn tatsächlich basieren auch Songs, die nicht direkt wie ein Original klingen, auf den Ideen von Musikern. Eine KI kann schließlich nichts komplett neu entwickeln, sondern kombiniert nur Dinge, die sie bereits vorgefunden hat. Das haben in England auch schon einige Musiker erkannt (s. hier) und sich deutlich gegen diese Entwicklung positioniert.

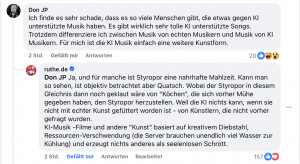

Der Cartoonist Ralph Ruthe hat das ganze Dilemma mit KI-Musik in einer Antwort auf einen User-Kommentar, der sich unter einer Cartoon-Idee (in welcher der Begriff KI-Songs“ eigentlich nur am Rande vorkommt) auf seiner Facebook-Wall findet, trefflich zusammengefasst:

Allerdings sind zurzeit weder Politik noch Unternehmen daran sonderlich interessiert, die Interessen von Musikern, die ihre kreativen Werke nicht einfach herschenken wollen an eine Technologie, die sie dann auch noch künftig mehr und mehr arbeitslos machen könnte, zu wahren. Apple Music hat nun immerhin eine KI-Kennzeichnung eingeführt, diese ist dann jedoch freiwillig (s. hier). Na hurra, das klappt ja immer richtig gut. Nicht. Aber ist ja auch klar: Radiosender beispielsweise sparen eine Menge Geld, wenn sie KI-Songs spielen, denn dafür müssen sie keine Gebühren an Urheberrechtsorganisationen wie die GEMA abführen. Was dann dazu führt, dass richtige Musiker weniger Einnahmen haben. So sind einige Privatsender schon dazu übergegangen, vor allem nachts in erster Linie KI-Gedudel im Programm zu haben (s. hier). Und wenn es um Geld geht, was größere Unternehmen sparen können, dann zeigt sich die Politik ja leider meistens sehr unternehmensfreundlich. Insofern erwarte ich hier leider keine vernünftige Regulierung im Sinne der Kulturschaffenden.

Und dann wird KI auch noch dazu genutzt, um Streamingzahlen von KI-generierter Musik zu generieren via Fake-Accounts, die das Zeug immer wieder automatisiert abspielen bei Streamingdiensten. Dafür gibt es dann Geld, und zwar nicht wenig, wie gerade bei einem Prozess in den USA deutlich wurde (s. hier). Die Kohle kommt dann aus den Töpfen, in welche die User der Streamingdienste einzahlen – und wird dann den richtigen Musikern, deren Songs von richtigen Menschen angehört werden, vorenthalten.

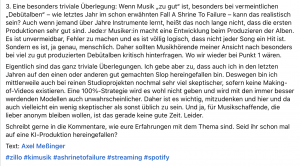

Es gibt wohl nicht wenige Musikhörer, die darauf keinen Bock haben, weil sie nämlich wissen, dass so den Künstlern, die sie selbst schätzen, mehr und mehr die Existenzgrundlage entzogen wird. Und so hat beispielsweise Axel Meßinger auf dem Gothic-Musik-Account „Zillo“ auf Facebook folgende Tipps formuliert, wie man KI-Musik erkennen kann, um nicht darauf reinzufallen:

Schon vor knapp drei Jahren hab ich ja in einem Artikel festgestellt, dass KI-generierte Musik eigentlich ziemlich grotesk ist, denn schließlich ist Musik ja nun mal etwas, was von Musikern gern gemacht wird, weil sie Spaß daran und zudem oft auch noch eine Intention dabei haben. Sollte man KI also nicht besser für Tätigkeiten nutzen, die Menschen keine Freude machen?

Doch nicht nur in der Branche der Musikschaffenden droht KI vielen Menschen ihre Lebensgrundlage zu entziehen, auch in anderen Bereichen ist zu erwarten, dass etliche Jobs verloren gehen werden, weil KI das schlicht und einfach billiger erledigen kann. Und dabei geht es nun nicht nur um Arbeitsstellen mit sehr unangenehmen, weil beispielsweise schmutzigen, gefährlichen oder extrem monotonen Tätigkeiten, sondern auch um Menschen, die ihre qualifizierten Jobs recht gern ausüben.

So haben beispielsweise Synchronsprecher schon darauf aufmerksam gemacht, dass sie keine Lust haben, ihre Jobs an künstliche Intelligenz zu verlieren, und daher auch nicht bereit sind, für das Training der entsprechenden KI Inhalte bereitzustellen – und das auch noch, ohne adäquat dafür entlohnt zu werden (s. hier). Interessant dabei, dass es vor allem der Streamingdienst Netflix ist, der da diese Entwicklung vorantreibt, denn daran wird dann deutlich, welche Gefahren für den Kulturbetrieb entstehen aufgrund der monopolistischeren Strukturen des Streamingmarktes. Darauf machte ich ja auch schon vor einigen Jahren mal in einem Artikel aufmerksam.

Aber auch in vielen anderen Branchen werden wohl etliche Jobs wegfallen bzw. von KI ersetzt oder zumindest reichlich reduziert werden. So prognostiziert beispielsweise Alex Karp, CEO von Palantir, dass vor allem Frauen mit hoher Bildung Probleme haben werden, noch adäquate Beschäftigungen zu finden (s. hier). Und auch schon jetzt, wenn KI zur Steigerung der Effizienz genutzt werden soll, geschieht dann oft das Gegenteil, nämlich sogenannter „AI Brain Fry“ (s. hier): Die Mitarbeiter fühlen sich ständig überwacht und überfordert von der gleichzeitigen Nutzung mehrerer KI-Tools, sodass sie unproduktiver werden und mehr Fehler machen. Da braucht man nicht allzu viel Fantasie, um sich vorzustellen, dass Unternehmer dann lieber auf solche Angestellten verzichten, sobald sich die Möglichkeit ergibt, alles gleich von KI erledigen zu lassen.

Denn ein Herz für Arbeitende darf man von KI-begeisterten Unternehmen nicht erwarten. Was man auch daran sieht, dass das, was uns zurzeit als KI verkauft wird, allzu oft noch menschliche Arbeit ist – nur eben ausgelagert in afrikanische oder asiatische Länder, wo Menschen für einen Hungerlohn Daten analysieren und sortieren, sodass dann „smarte“ Geräte den Eindruck erwecken, sie wären tatsächlich von selbst intelligent (s. hier). Besonders große Menschenfreundlichkeit ist also von den Tech-Oligarchen und ihren Anhängern nicht unbedingt zu erwarten. Von Elon Musk und Peter Thiel ist das ja mittlerweile hinreichend bekannt, aber auch Sam Altman von OpenAI machte ja kürzlich durch Verhalten auf sich aufmerksam, dass von einem Betroffenen als „soziopathisch“ bezeichnet wurde (s. hier). Und das sind dann die Leute, welche die Wertmaßstäbe bei der Entwicklung von KI vorgeben. Puh …

Da KI noch nicht umfassend in der realen Welt agieren kann, gibt es jetzt sogar schon eine Plattform, auf der KI-Agenten Menschen anheuern, um Tätigkeiten für sie auszuführen (s. hier). Klingt dystopisch? Finde ich auch. Zumindest wird die Vorstellung, dass KI den Menschen dienen und ihr Leben erleichtern soll, damit schon mal reichlich ad absurdum geführt.

Diese Entwicklung wird auch von Experten wie dem KI-Forscher Nate Soares kritisch gesehen. So meint er in einem Interview mit dem Handelsblatt (leider nur zum Teil ohne Bezahlung lesbar):

Was zeigt uns die Plattform Moltbook, wo sich KIs miteinander unterhalten?

Was man von Moltbook definitiv lernen kann, ist, wie seltsam sich die KIs zunehmend verhalten. Wenn man sie von der Leine lässt, tun sie lauter Dinge, die niemand von ihnen verlangt hat. Sie agieren autonom, bizarr und nicht besonders herzerwärmend, aber noch nicht bösartig.Betonung auf noch?

Solange die KI-Modelle relativ dumm waren, war all das kein Problem. Aber wenn Sie die Intelligenz dieser Systeme weiter steigern, dann entstehen KIs, die sich überhaupt nicht mehr für uns interessieren. Vielleicht bauen sie in Zukunft eine „User Farm“ auf, in der sie Menschen züchten, die besonders leicht zufriedenzustellen sind, um ihre Ruhe vor uns zu haben. Oder Schlimmeres.

Klingt jetzt nicht eben beruhigend, oder? Vor allem steht Soares mit seiner Einschätzung nicht allein da. So hat beispielsweise der KI-Pionier Yoshua Bengio in einem Interview mit SRF Anfang des Jahres geäußert, dass er mittlerweile bedauert, so unbedarft an die Entwicklung von KI herangegangen zu sein, und nun bemüht ist, KI entsprechend zu gestalten, dass sie keinen Schaden anrichten kann. Und auch dass man immer wieder liest, dass KI-Experten ihren Job hinschmeißen und dies unter anderem damit begründen, dass sie befürchten, KI könnte komplett außer Kontrolle geraten (s. beispielsweise hier), ist ein deutliches Anzeichen dafür, dass diejenigen, die sich damit auskennen, mittlerweile immer öfter skeptisch einer zügellosen Weiterentwicklung von KI gegenüberstehen.

Roberto Simanowski entwirft in einem Artikel in den Blättern für deutsche und internationale Politik eine Vorstellung, wie man KI weiterhin konstruktiv nutzen könnte. Das ginge allerdings nur, wenn man KI-Anwendungen zum einen vor allem als Hilfsmittel sieht und zum anderen die Medienkompetenz bei der Nutzung von KI deutlich fördern würde. Und zwar nicht nur in Bezug darauf, wie man KI nutzt, sondern auch, wie man mit Antworten von KI umgeht, diese einordnet oder auch Schwachstellen darin erkennt.

Ob das allerdings heutzutage so hinhaut, wo doch Menschen immer mehr als dumpfe Konsumenten verstanden werden, die möglichst nicht zu viel nachdenken sollen? Und wo Bildung vor allem auf funktionale Aspekte reduziert wird, die aus Kindern gut verwertbare Humanressourcen machen sollen? Ich hab da so meine Zweifel. Vor allem, wenn der öffentliche Diskurs in immer größerem Maße von den Tech-Oligarchen bestimmt wird (beispielsweise wenn diese sich Medien kaufen), die ja damit Geld machen, dass Menschen möglichst unreflektiert die ihnen angebotenen KI-Tools nutzen.

Woran man auch sieht, dass das Ganze in eine verkehrte Richtung läuft: KI-Spielzeug auch schon für Kleinkinder ist zurzeit ein Riesentrend. Da frohlocken die Hersteller, aber Experten sehen das durchaus kritisch (s. hier). Kinder könnten erhebliche Defizite im Bereich des sozialen und emotionalen Lernens bekommen, wenn sie einen KI-Spielkameraden haben, der immer für sie da ist, nie schlechte Laune hat, ihnen auch nicht widerspricht und dann auch noch teilweise kompetentere Antworten geben kann als die eigenen Eltern. Warum dann also noch mit anderen richtigen Kindern spielen, die schon mal Anforderungen an einen selbst stellen, weil sie eben nicht ständig gut drauf sind und auch mal eigene Ansichten haben?

Daher fordern Experten eine strengere Regulierung von solche Spielzeugen, da erst einmal gründlich untersucht werden sollte, wie deren Auswirkungen auf die kindliche Entwicklung sind. Aber wie das immer so ist: Regulierungen gelten ja Neoliberalen stets als Teufelszeug, und wenn mit einer Sache Geld gemacht werden kann, dann reicht das in der Regel schon als Legitimation, um das dann einfach so laufen zu lassen.

Das ist nämlich die grundsätzliche Crux bei KI-Anwendungen: Diese können sehr sinnvoll sein, beispielsweise tatsächlich beim kindlichen Lernen, aber auch in der Medizin oder beim Programmieren. Dafür bräuchte es allerdings eine streng reglementierten und gut durchdachten Einsatz solcher Tools, und davon sind wir leider zurzeit sehr weit weg.

Die Tech-Oligarchen schwärmen ja zudem schon davon, dass bald eine AGI (artificial general intelligence) das Licht der Welt erblicken könnte. Das wäre dann kein Tool mehr, was Menschen nutzen, sondern eine sich schnell verselbstständigende Entität, die vermutlich nur noch ausgesprochen schwer zu kontrollieren wäre. Und wenn diese AGI dann auf die ganzen Daten, die bisher für KI-Entwicklung gesammelt wurden, und auf die immer zahlreicheren Smarthome-Geräte zurückgreifen könnte, dann würden wir sehr schnell bei einer totalen Überwachung durch eine Sache landen, die keine menschlichen Wertmaßstäbe hat. Ich weiß nicht, ob ich das unbedingt erstrebenswert finde.

Was man vor allem bei all dem auch im Hinterkopf haben sollte: KI ist nicht immun gegen Fehler. Ganz im Gegenteil: Wenn beispielsweise falsche Darstellungen einer Sache erst mal im Internet sind, dann nutzt KI diese auch, um zu lernen – siehe hier am Beispiel von Tierbildern. Und reproduziert diese fehlerhaften Informationen dann erneut. Was wiederum dazu führt, dass eine andere KI das in ihr Lernschema einbaut – und je mehr von solchen falsch reproduzierten Dingen dann im Netz vorhanden sind, desto stärker verbreiten die sich dann auch weiter über KI.

So könnte es dann irgendwann passieren, dass unser Bild von einer Sache nicht dem tatsächlichen entspricht, sondern dem KI-generierten. Bei Tierbildern mag das noch einigermaßen zu verschmerzen sein, aber bei komplexeren Zusammenhängen braucht es nicht viel Fantasie, um sich vorzustellen, dass das sehr unangenehme Folgen haben könnte. Beispielsweise dass die Glaubwürdigkeit von Informationen noch weiter abnimmt. Oder dass gezielt Falschinformationen gestreut werden, um sie via KI dann weit zu verbreiten. Oder dass Menschen die Realität anzweifeln, auch wenn sie diese direkt vor Augen haben, weil sie eben nicht so ist, wie sie sich ihnen online immer präsentiert. O. k., das haben wir bei AfD-Jüngern auch heute schon allzu oft – aber besser würde das mit Sicherheit nicht.

Das ist übrigens keine Zukunftsmusik, sondern passiert schon jetzt und hier. In einem Artikel von Mimikama wird geschildert, wie sogenannte KI-Schwärme das perfektionieren, was durch Troll-Bots bisher in sozialen Medien doch eher stümperhaft (wenngleich immer noch für wenig reflektierte User offenbar glaubwürdig) gemacht wurde: Fake News verbreiten, auf Tatsachen beruhende Aussagen diskreditieren, unerwünschte Äußerungen diskreditieren und so eine Mehrheit für abstruse Ansichten suggerieren, die gar nicht vorhanden ist. Zu Recht wird das als „Gefahr für unsere Demokratie“ bezeichnet:

Die Bedrohung durch KI-Schwärme geht weit über Fake News hinaus. Es geht nicht nur um falsche Inhalte, sondern um die Zerstörung des Vertrauens in öffentliche Debatten. Wenn tausende künstliche Stimmen einen Standpunkt vertreten, wird dieser als mehrheitsfähig wahrgenommen – selbst wenn er faktisch falsch ist. Das ist nicht nur Desinformation, das ist psychologische Kriegsführung. Künstlich erzeugte Einigkeit untergräbt den natürlichen Streit, den jede Demokratie braucht. Meinungsvielfalt wird zur Kulisse für eine inszenierte Wirklichkeit. Und es hört nicht bei der Meinung auf: Auch Symbole, Sprache und kulturelle Identität werden gezielt manipuliert. Die Gefahr ist subtil, aber umfassend. Wer kontrolliert, was als „normal“ erscheint, kontrolliert auch, was als „wahr“ gilt. Das ist keine Zukunftsmusik, sondern bereits im Gange. Und genau deshalb braucht es jetzt klare Antworten.

Solche geforderten klaren Antworten habe ich bisher allerdings aus der Politik noch nicht vernommen.

Und wenn man dann noch bedenkt, dass dieser ganze KI-Hokuspokus auch noch einen enormen Energiehunger hat, da die dafür notwendigen riesigen Rechenzentren ja jede Menge Strom benötigen, dann kommt noch ein ganz anderer negativer Aspekt hinzu. Schließlich haben wir als Weltgemeinschaft nicht unbegrenzt Energie zur Verfügung, zum anderen wird Energie eben immer noch viel zu oft aus fossilen Energieträgern gewonnen, was dann wieder die Klimakrise weiter befeuert. Ist jetzt auch nicht richtig erstrebenswert, oder?

Man wird ja schnell als Fortschrittsfeind, der am liebsten wieder zurück in die Steinzeit möchte, gebrandmarkt, wenn man solche kritischen Gedanken hegt und auch noch anderen mitteilt. Ich finde allerdings, dass die aufgezeigten negativen Auswirkungen von KI, die teilweise schon erlebbar sind, so erheblich sind, dass man sich zumindest mal damit befassen sollte.

Rückabwickeln werden wir das Ganze sowieso nicht können, denn das ist ja das Fiese bei der Büchse der Pandora: Das Ding geht nicht einfach so wieder zu. Also sollte zumindest Schadensbegrenzung betrieben werden, und dafür ist es wichtig, erst mal ein Problembewusstsein zu schaffen. Schwierig genug, denn die KI-Befürworter und -Vorantreiber haben ja die „Ist ja alles so schön bunt hier“-Sichtweise auf ihrer Seite …

Abschließend noch ein kleiner Cartoon, den ich auf der Facebook-Wall von Rainer Hofmann entdeckt habe und der eines der Probleme der KI-Nutzung sehr treffend humoristisch darstellt: